Archivi categoria: epistemologia

Un approccio relativistico dissolve lo hard problem?

Nir Lahav e Zachariah A. Neemeh hanno scritto nel 2022 un articolo fondamentale dal titolo A Relativistic Theory of Consciousness.

L’ambizione del saggio è duplice: dissolvere lo hard problem della coscienza (sollevato da David Chalmers) e dissolvere anche il problema del carattere privato della coscienza.

Come è noto, Chalmers considera “difficile” il problema di spiegare perché abbiamo una coscienza, dal momento che tutto potrebbe benissimo funzionare identicamente anche se fossimo tutti zombies senza coscienza. Tale tesi deriva dall’assunzione che il nostro funzionamento come sistemi percettivo-cognitivi sarebbe identico anche se non fossimo coscienti. Infatti, se intendiamo che un sistema di questo tipo funzioni egregiamente se risponde agli stimoli/input che gli provengono dall’ambiente “computando” (attraverso il sistema nervoso centrale) comportamenti/output adeguati, che bisogno c’è che a questa macchina meravigliosa si aggiunga anche la coscienza?

La cosa si comprende ancor meglio se si considera il dilemma posto classicamente dalla filosofia della mente:

- o la coscienza (in quanto sopravviene, cioè “si aggiunge” all’attività dei circuiti neurali) assolve una funzione, cioè ha un ruolo causale, che l’organismo/cervello senza di essa non assolverebbe [ma allora, in questa prospettiva definibile come dualistica, alcunché di “immateriale” interagirebbe con il cosmo fisico (come la res cogitans cartesiana attraverso la ghiandola pineale), in modo tale che in questo cosmo accadrebbero cose diverse da quelle che accadrebbero in assenza della coscienza medesima, e ne risulterebbe rotta la chiusura causale del mondo fisico (e sarebbe confutato il c.d. fisicalismo)];

- oppure la coscienza è un tratto free rider, una sorta di ombra che accompagna l’attività neurale, che non modifica in alcun modo il decorso degli eventi determinato da questa attività neurale [ma in questo caso la coscienza resterebbe del tutto gratuita ed essenzialmente inesplicata (cosa che appare davvero bizzarra, dato il carattere particolarissimo della coscienza)].

Come fanno gli autori dell’articolo in parola a dissolvere questo hard problem?

Essi rifiutano anche la prospettiva illusionistica (o eliminativistica) secondo la quale la coscienza è alcunché di illusorio e inesistente (cosa che ovviamente ripugna all’esperienza che ne abbiamo).

Essi, adottando un approccio essenzialmente monistico (per la precisione un dual aspect monism), negano (attraverso una complicata formalizzazione matematica che, tuttavia, non è strettamente necessaria per comprendere il cuore della loro argomentazione) che sia possibile che un sistema percettivo-cognitivo (identico a quello umano), descritto sotto il profilo esclusivamente neurocomputazionale, possa essere zombie, cioè “assolutamente” privo di coscienza.

La tesi fondamentale degli autori è la seguente:

A system either has or doesn’t have phenomenal consciousness with respect to some observer.

Un sistema percettivo-cognitivo appare privo di coscienza soltanto per un altro sistema percettivo-cognitivo, cioè all’interno di un sistema di riferimento centrato su questo secondo sistema,

esattamente come uno stesso corpo, in base alla teoria della relatività, può avere masse diverse (e anche essere caratterizzato da lunghezze spaziali differenti e intervalli temporali di differente durata) a seconda che lo si osservi dal suo punto di vista o da un punto di vista esterno.

In generale:

Phenomenal consciousness is neither private nor delusional, just relativistic. In the frame of reference of the cognitive system, it will be observable (first-person perspective) and in other frame of reference it will not (third-person perspective). These two cognitive frames of reference are both correct, just as in the case of an observer that claims to be at rest while another will claim that the observer has constant velocity. Given that consciousness is a relativistic phenomenon, neither observer position can be privileged, as they both describe the same underlying reality.

Questo stesso ragionamento porta a spiegare la ragione per la quale le “esperienze soggettive” sembrano avere carattere privato e incomunicabile (quello che percepisco io in questo momento, tu, che mi leggi, non lo percepisci; quanto meno non mai esattamente come lo percepisco io).

Ciò che io percepisco è un insieme di fenomeni mediati dal mio sistema percettivo-cognitivo che, nella mia prospettiva, si rende trasparente a se stesso (così come, se inforco occhiali adatti e ben puliti, posso vedere distintamente le cose che mi circondano senza vedere le lenti).

Philosophers refer to this feature of phenomenal consciousness as “transparency”: we seem to directly perceive things, rather than mental representations, even though mental representations mediate experience.

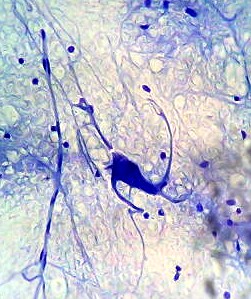

Ma se facciamo centro in un altro sistema percettivo-cognitivo (ad esempio nel tuo) ecco che il mio sistema percettivo-cognitivo appare come un intrico di reti neurali attraversato da scariche elettriche e flussi di neurotrasmettitori, senza che tu abbia alcuna percezione di ciò che io percepisco.

While Alice may observe herself feeling happiness as she’s looking at a rose, Bob will only measure patterns of neural activity. [Like in] the case of constant velocity, wherein Alice claims to be at rest while Bob is moving, while Bob claims that Alice is the one moving and that he is stationary. From Alice’s perspective, she has qualia and Bob only has patterns of neural activation, while from Bob’s perspective Alice just has patterns of neural activation while he has qualia.

Dunque non si ha mai un sistema percettivo-cognitivo che funziona come uno zombie, ma si ha sempre solo un sistema percettivo-cognitivo che è conscio di qualcos’altro; e questo qualcos’altro può anche essere un altro sistema percettivo-cognitivo che appare al primo sistema in modo diverso da come appare a se stesso; anzi, in quanto è trasparente a se stesso, in modo diverso da come non appare a se stesso.

Qualia and eidetic structures are not private and hence phenomenal consciousness is neither some mysterious force beyond the realm of science nor an irreducible element of reality. Rather, they appear to be private because in order to measure them, one needs to be in the appropriate frame of reference, viz., that of the cognitive system in question [...]. It is ultimately a question of causal power. Only from this frame of reference is there causal power for the representations in the dynamics of the system. Only from the frame of reference of the cognitive system are these neural patterns recognized as representations [...]. These representations are the input and output of the cognitive system [...]; they are the ones that cause the dynamics in this cognitive frame of reference. From outside that observer reference frame, as in the position the neuroscientist takes as a third-person observer, the same exact phenomena appear as neural computations. This is because the third-person perspective is constitutively outside of the dynamics of representations of the cognitive system in question, and hence these representations do not have any causal power over the neuroscientist

Gli autori giungono a definire un principio di equivalenza in base al quale “qualitative and quantitative aspects of consciousness are formally equivalent“, cioè la mia percezione p.e. di una mela rossa è sempre traducibile, mediante opportune trasformazioni, in un insieme di processi neurocomputazionali correlati a tale mia percezione (tali processi sarebbero nient’altro che questa stessa mia percezione così come appare non a me, ma a un altro che studia il mio cervello mentre io ho questa percezione).

In questa prospettiva, dunque, non si tratta di entità diverse: una materiale (il cervello) e l’altra immateriale (la coscienza) di cui occorra comprendere la relazione e, soprattutto, perché (hard problem) e come (easy problem) la prima generi la seconda (per assolvere quale funzione). Si tratta del medesimo sistema riguardato (cioè come appare) all’interno di sistemi di riferimento diversi (il proprio e un altro).

Questa prospettiva corrisponde, come gli stessi autori suggeriscono, a una prospettiva fenomenologica naturalizzata, come quella “sognata” ad es. da Francisco Varela (prima di morire): ciò che un (filosofo) fenomenologo individua come tratti caratteristici della coscienza che abbiamo del mondo (l’esempio che fanno gli autori, che evocano Husserl e Heidegger, riguarda il modo in cui facciamo esperienza del tempo) può essere “spiegato” anche in termini di funzionamento di strutture di tipo neurocomputazionale.

Questo progetto è senz’altro condivisibile, nella misura in cui non pretende di ridurre il lato fenomenologico al lato “meccanico”, ma, in un orizzonte monistico, li tiene insieme entrambi come aspetti di un tutto inscindibile.

Gli autori, infatti, si considerano giustamente fisicalisti, ma di un fisicalismo tuttavia allargato e non riduzionista. La coscienza non sarebbe illusoria (come per l’eliminativismo), ma sarebbe, per così dire, “l’altra faccia” dei sistemi fisici.

Physical patterns (e.g., of neural representations) and phenomenal properties (e.g., qualia) are two sides of the same coin.

Si sarebbe tentati, tuttavia, di trarre da questo approccio conclusioni piuttosto minimaliste: la coscienza potrebbe essere considerata, in questa prospettiva, un carattere in ultima analisi free rider, emergente in modo eccezionale e accidentale in condizioni molto particolari, all’interno di un universo prevalentemente meccanicistico, cieco e inconscio.

Proprio in quanto lo hard problem risulta dissolto pare che si debba rinunciare anche alla connessa ipotesi “panpsichistica” cara ad es. a Chalmers (cioè all’ipotesi che la coscienza sia qualcosa di “trascendente” che pervade l’universo, invocata come tale appunto in quanto inesplicabile fisicalisticamente).

Ma l’hard problem è davvero dissolto?

Si e no.

Certamente, gli autori, come altri prima di loro (Marco Giunti, ad esempio), hanno portato buoni argomenti contro l’ipotesi zombie, cioè che possano concettualmente esistere organismi viventi in tutto e per tutti simili a noi, ma privi di coscienza.

Tuttavia, resta la differenza tra a) sistemi di elaborazione di informazioni privi di coscienza, come ad es. una videocamera (che traduce informazioni tratte da onde luminose in informazioni registrate su supporto magnetico) o anche un organismo profondamente addormentato che, tuttavia, minimalmente, reagisce agli stimoli dell’ambiente, e b) sistemi di elaborazione di informazioni coscienti (sistemi cognitivi, nel linguaggio degli autori). Quando, come e perché in certi sistemi sorge la coscienza? Qui torniamo alle risposte classiche di Tononi, Baars etc. Ma, se queste possono, almeno a livello congetturale, risolvere lo easy problem (quale soglia deve essere superata, p.e. in termini di integrazione tra le informazioni, affinché si dia coscienza; o quali componenti del sistema nervoso centrale devono essere eccitati etc.), rimane il problema di capire perché le stesse funzioni assolte dalla coscienza non potrebbero essere assolte in assenza di essa.

Sotto questo profilo l’esistenza della coscienza, anche se considerata dagli autori un “non problema”, in quanto essa, all’interno del loro paradigma monistico, sarebbe “spontaneamente” parte di un sistema cognitivo, che evidentemente abbia raggiunto una certa complessità (senza che tale sistema possa operare in “modalità zombie“, cioè inconsciamente), resta nei fatti un problema, a meno che non ci si risolva, appunto, minimalisticamente, a considerarla un tratto free rider, privo di ruolo causale, accidentalmente associato a certi stati cerebrali.

Gli autori stessi sono consapevoli di questo problema, quando scrivono:

There are still several open questions that need to be addressed in the future. For example, what are the necessary and sufficient conditions for a cognitive frame of reference to have phenomenal consciousness?

Tuttavia, secondo me, l’intuizione degli autori, consistente nel considerare l’emergere della coscienza dal punto di vista relativistico, oltre a risolvere l’annosa questione del carattere privato della coscienza, ha il pregio di rimarcare il carattere che chiamerei trascendentale e, come tale, irriducibile della coscienza (gli autori, del resto, come detto, si proclamano fisicalisti, ma non riduzionisti).

Consideriamo la cosa sotto il seguente profilo. Tutto il ragionamento sviluppato dagli autori, come abbiamo visto, si regge sulla tesi ampiamente argomentata dell’impossibilità di sistemi zombie. Addirittura gli autori si spingono a sostenere che un sistema cognitivo artificiale (“ALICE”) in tutto e per tutto assimilabile per il suo funzionamento a un sistema naturale (“Alice”) dovrebbe essere altrettanto cosciente.

N. B. Quest’implicazione, astrattamente corretta, a me pare implausibile: un sistema artificiale, cioè non organico, potrebbe non avere un’organizzazione interna davvero assimilabile a un sistema vivente. Tuttavia, sono d’accordo con gli autori che, se un determinato sistema fosse del tutto equivalente a un sistema vivente cosciente, sarebbe un sistema vivente cosciente. Non è però scontato che sia sufficiente che l’equivalenza debba riguardare soltanto i due sistemi in quanto processano informazioni, come pensano gli autori quando sostengono che, senz’altro,

the neurocomputational structures are equivalent to the phenomenal structure.

Infatti, può darsi che la coscienza richieda altro rispetto a ciò che oggi comunemente associamo al termine “cognitivo” in senso funzionale (“neurocomputazionale”, nel lessico degli autori). Ma la questione qui può essere lasciata aperta, in quanto non è pertinente alle ragioni del mio interesse per la teoria degli autori.

La coscienza, dunque, in quanto caratteristica di ogni sistema percettvo-cognitivo propriamente detto (cioè tale da aver raggiunto, evidentemente, la sufficiente complessità), dovrebbe essere molto più diffusa di quello che si potrebbe credere (come argomentano, ad esempio, in modo convincente, Ginsburg e Jablonka, sulla base di un principio di analogia, in riferimento agli animali che consideriamo “inferiori”).

Ma, soprattutto, tutto il ragionamento poggia sul diverso modo in cui appaiono le cose (e, in particolare, i sistemi percettivo-cognitivi) a seconda che si adotti una prospettiva in prima persona (cioè a partire da un sistema percettivo-cognitivo trasparente a se stesso)…

the first-person perspective [...] is the cognitive system from its own observer perspective

… o una prospettiva in terza persona. Il “mio” sistema percettivo-cognitivo, che a me appare trasparente (cioè non appare affatto), ad altri può apparire come intrico di neuroni etc.

Quello che non è dato sapere è come siano le cose in se stesse. Quando gli autori invocano i diversi “sistemi di riferimento” di fatto invocano diverse “prospettive” cioè diverse forme della coscienza. Al di fuori di un sistema di riferimento (proprio o altrui), nella stessa logica degli autori, sembra difficile poter parlare di “universo” o di “realtà”

(come del resto accade anche se si adotta la prospettiva della relatività generale per la quale è necessario conoscere lo stato dell’osservatore, p.e. in quiete o in moto relativo, rispetto ai diversi sistemi fisici che osserva o in cui è immerso, per caratterizzare questi stessi sistemi fisici).

È vero che gli autori, dichiarandosi fisicalisti, precisano quanto segue:

We avoid the term “first-person perspective” because of its occasional association with immaterial views of consciousness; cognitive frames of reference refer to physical systems capable of representing and manipulating inputs. These systems have physical positions in space and time and instantiate distinct dynamics.

Tuttavia, nonostante queste avvertenze, va ricordato che per gli autori

a cognitive frame of reference [---] is the perspective of a specific cognitive system from which a set of physical objects and events are being measured

Ne segue che

- un sistema di riferimento cognitivo trasparente a se stesso (peraltro chiamato dagli autori anche “osservatore”) è esattamente una prospettiva in prima persona;

- il fatto che questo sistema abbia “una posizione fisica” nello spazio e nel tempo non comporta che tale posizione sia “assoluta”: spazio e tempo non possono che dipendere dallo stesso (o da un altro) sistema di riferimento (nulla, compresi spazio e tempo, è ciò che è assolutamente, ma ha certe proprietà solo a partire da un determinato sistema di riferimento / osservatore).

Del resto gli stessi autori dichiarano:

The essence of the relativistic principle is that there is nothing over and above the observer.

In definitiva l’invito (forse involontario) di questo articolo mi sembra sia quello di adottare una prospettiva radicalmente fenomenologica e di istituire relazioni (matematiche) tra fenomeni senza che vi sia alcuno spazio residuo per una pretesa “realtà in sé”. Se non è panpsichismo, è comunque una prospettiva in cui la coscienza (l’osservatore), nelle sue diverse manifestazioni (prospettive), appare imprescindibile.

N.B. Qualcuno potrebbe obiettare che “osservatore” o “sistema di riferimento”, nel lessico della relatività di Einstein, non implicano necessariamente la “coscienza” in senso fenomenologico. Ma, se questo è vero appunto nella fisica di Einstein, non è vero nella teoria relativistica della coscienza: infatti, la tesi degli autori è che un sistema percettivo-cognitivo, in quanto tale, è sempre anche “naturalmente” cosciente.

Si potrebbe, infatti, trarre la seguente conclusione: se, come gli autori suggeriscono, adottiamo una teoria relativistica della coscienza, cioè, in ultima analisi, consideriamo che gli stessi sistemi cognitivi di riferimento possono apparire o meno coscienti a seconda che siano osservati da se stessi o da altri, ciascun sistema cognitivo di riferimento è trasparente quanto meno a se stesso e, dunque, cosciente; non è dato, cioè, alcun sistema cognitivo di riferimento, rispetto al quale l’universo sia completamente privo di osservatori, in quanto ciascun sistema cognitivo di riferimento deve essere considerato sempre anche come un osservatore.

Alla luce di questo modello si potrebbe ad esempio risolvere l’annosa questione del sonno profondo. Quando dormo di sonno profondo agli occhi di altri, cioè all’interno di altri sistemi cognitivi di riferimento , io sono vivo, respiro e scorre del tempo. All’interno del mio sistema cognitivo di riferimento questo tempo, tuttavia, non esiste assolutamente. È saltato. Io mi addormento e mi risveglio senza soluzione di continuità, dal momento che un sistema cognitivo di riferimento trasparente a se stesso non può mai essere inconscio.

Che dire di quando morirò?

Qui si apre la classica alternativa: o non ci sarà risveglio, come nelle prospettive materialistiche à la Epicuro, oppure ve ne sarà uno altrove, come nelle prospettive soteriologiche à la Platone, legate o meno a dottrine trasmigrazioniste.

Curiosamente gli argomenti platonici a favore dell’immortalità dell’anima possono vantare la stessa matrice degli argomenti di Epicuro contro la paura della morte. Si tratta del teorema di Parmenide “Ciò che è è e non può non essere”, traducibile, nel lessico degli autori dell’articolo qui discusso, come: “Non si dà nessun sistema cognitivo di riferimento che non sia cosciente e trasparente a se stesso”.

Come è noto, nella Lettera a Meneceo Epicuro rassicura il suo corrispondente con l’osservazione: “Quando c’è la morte non ci siamo noi, quando ci siamo non c’è la morte”. Stranamente, però, Epicuro non ne deriva l’immortalità dell’anima, ma solo l’impossibilità di fare esperienza del passaggio dalla vita alla morte (proprio come non si può fare esperienza del passaggio dalla veglia al sonno).

Viceversa, nel Fedone, Platone, deriva dalla nozione di “anima” come sostanza contraddistinta dalla proprietà dell’esser viva (noi diremmo: di esserci) l’impossibilità (la contraddittorietà) per l’anima dell’esser morta.

Chi ha ragione?

Per un monismo neutrale e una fenomenologia naturalizzata

Ricapitolazione fenomenologica

A mindful universe?

Il volume di Henry P. Stapp, Mindful Universe: Quantum Mechanics and the Participating Observer, London, Springer 2014 convince e delude insieme.

- La chiusura causale del mondo fisico contraddistingue soltanto il determinismo proprio della fisica classica.

- La MQ è una teoria incompleta sotto questo punto di vista.

- Il cervello, nelle sue parti “fini” (come le sinapsi, gli assoni ecc.), obbedisce necessariamente alle leggi della MQ e non a quelle della fisica classica.

- Non ha dunque senso applicare un modello deterministico-meccanicistico al cervello.

- Il libero arbitrio (“free will” o “free choice“), inteso come il fatto che le nostre azioni, in quanto determinate del cervello, non possano essere spiegate deterministicamente sulla base di un certo numero di leggi e di condizioni di partenza, anche se le conoscessimo nel dettaglio, è assolutamente possibile.

- A noi sembra di possedere il libero arbitrio, inteso anche come la facoltà di decidere di noi stessi liberamente, p.e. di alzare un braccio senza che tale nostra scelta sia predeterminata e resa inevitabile da qualcosa prima che la decisione sia presa.

- Lo sforzo di spiegare questo “libero arbitrio” come puramente apparente e di ricondurlo a catene causali meccaniche è mal riposto: non c’è alcuna necessità di questa riduzione, anzi essa è in linea di principio impossibile.

- Tutto lascia credere che l’impressione che abbiamo di essere liberi corrisponda alla realtà: nello stesso modo in cui facciamo della nostra esperienza il criterio per valutare la veridicità di asserzioni che si riferiscono al mondo esterno, non c’è ragione di rifiutare questa esperienza quando si tratta del libero arbitrio.

An anthropic bias?

The book by Nick Bostrom, Anthropic bias: Observation Selection Effects in Science and Philosophy, London, Routledge 2002 (ed. on line 2020), is certainly of great interest, even for those who investigate the origin and nature of consciousness.

Bostrom’s approach

This volume discusses the vexed question of the so-called “anthropic principle”. According to this principle our universe is characterized by certain parameters because these are the only ones compatible with “our” existence (in this sense it is a “fine-tuned” universe).

For “our” existence – Bostrom clarifies (in chap. 1) – it mustn’t be understood the existence of Homo sapiens, as living species, even if originally (in 1974) Brandon Carter had called this principle ambiguously “anthropic”. It must be understood the existence of “observers” of the universe itself (or also, as sometimes Bostrom writes, the existence, on Earth or elsewhere, of “intelligent life”, in general). In short it is the question of why our universe not only exists, but is also “observable”.

Although, as I will discuss later, “observer” and “consciousness” do not necessarily have the same meaning, the question of the origin of an observable universe and the question of the origin of consciousness are clearly linked.

Regarding the origin of our universe, as an observable universe, the macro-theories that Bostrom discusses can be reduced to two:

- our universe is observable (hosts intelligent and conscious life) because of an intelligent design (i.e. something that has our appearance as goal) or

- it is as it is by chance.

Bostrom does not take the first hypothesis seriously: intelligent design is rejected, among other things, with the following argument: in order to support it, we must prove that our universe should be the nicest possible, a feature that Bostrom considers obviously implausible. This argument is formalized, albeit hypothetically, resorting to the Bayes theorem, in chap. 11 with these words:

If our universe is not of the sort that one might have suspected a creator to create if he created only one universe (if our universe is not the “nicest” possible one in any sense, for example), then the conditional probability […] on any creator-hypothesis involving the creation of only one universe might well be so slim etc.

Bostrom considers more reliable (probably the only one worthy of a scientific treatment) the second hypothesis, that is that the universe arose by chance.

And why, then, is it so fine-tuned as it aimed at our existence or, better, the existence of observers?

Bostrom’s thesis is basically as follows: our universe appears “miraculously” fine-tuned because of a (trivial) observation selection effect: we certainly could not observe a universe where there were no observers! In general, according to Bostrom, if we want to do science we must take into account these observation selection effects (this is the great lesson of the anthropic principle, reinterpreted as “anthropic bias”): things (laws of nature, laws of evolution, initial conditions, etc.) appear to us in a certain way rather than in another on the basis that they can be observed by us. Laws of nature or initial conditions not compatible with the birth of intelligent (and conscious) life on Earth obviously cannot be “discovered”. This does not exclude (but, according to Bostrom, rather suggests) that there are infinitely more things, which, “by construction”, we will never know, precisely, those that we cannot observe.

In particular, accepted this non-theological and non-teleological perspective, which gives relevance to pure chance, the hypotheses are again two: or 1) our universe is the only existing universe or 2) it is one among countless or infinite other “universes”, the only observable one (or one of the few or many observable), which is why we observe this universe and not others.

Bostrom seems to favour this second hypothesis.

The argument is basically this: it would be really strange that only one universe has arisen randomly and that just this is fine-tuned and also hosts intelligent life, especially if we assume that this, in itself highly unlikely, would have been impossible in a universe even slightly different from ours. So, the multiverse hypothesis is much more likely.

This thesis is not only argued discursively, but also resorting to logical and mathematical tools, essentially to Bayes’ theorem and its derivatives. It is supported, in particular, by a central assumption in the book, the Self-Sampling Assumption (SSA), which, in its first form (introduced at the end of chap. 3 and subsequently improved and corrected), sounds as follows:

One should reason as if one were a random sample from the set of all observers in one’s reference class

To understand what Bostrom means by this assumption, one can mention its use in traffic analysis, as does Bostrom itself (in chap. 5). If you end up stuck in a queue where one lane is slower and one is faster, the fact that you’re probably in the slowest lane isn’t due to a goddamn “Murphy’s Law,” as you might think, but to the trivial circumstance that the slowest lane is also the one where the greatest number of vehicles is located, so probably yours too! In this example you are a “sample” taken from the set of all drivers who are in traffic (reference class). It seems more likely that you are in the slower lane than the faster one simply because there are more vehicles in this lane.

How does this assumption apply to the “anthropic principle”? Bostrom (in chap. 4) makes several thought experiments to illustrate this; then (in chap. 5 and following) he applies this assumption to several open scientific questions, variously connected with the anthropic principle, such as the origin of this universe, Boltzmann’s explanation of the time’s arrow, the evolution of intelligent life on Earth and possibly in other planets etc.

Here, for example, is how the SSA is applied in the Incubator gedanken (introduced in chap. 4 and resumed in chap. 10). Imagine tossing a fair coin: “If the coin falls tails then it creates one room and a man with a black beard inside it. If the coin falls heads then it creates two rooms, one with a black-bearded man and one with a white-bearded man. As the rooms are completely dark, nobody knows his beard color. Everybody who’s been created is informed about all of the above. You find yourself in one of the rooms. Question: What should be your credence that the coin fell tails?”. In the absence of any other information, if we were one of these newly “created” men, our credence of tails should be 1/2. However, if the lights are switched on and we discover that we have a black beard, according to the SSA our credence of tails should become 2/3.

The reasoning, expressed without recourse to mathematics, could sound like this: in the absence of other information the probabilities of head and tails are equal, but this is no longer true when I discover that I have a black beard: in fact, if the coin had fallen head, I could have had a white beard: therefore it is more probable that it has fallen tails. Indeed, what applies is Bayes’ theorem: the initial probabilities of a given event E may increase or decrease (so that they become final or conditional probabilities), if another F event occurs or does not occur or if a particular H theory is true or false. In the Incubator gedanken, knowing that I have a black beard (new event) gives me additional information (in favor of one theory rather than another) that makes me change my estimate of initial probabilities.

How does this SSA apply to scientific issues in which the anthropic principle is involved?

For example, Bostrom uses this SSA to argue (chap. 5) that it is theoretically possible to experimentally test which kind of view in quantum mechanics is most likely true between these two: the “single-history version” and the “many-worlds version”. According to the first view, whenever the collapse of the wave function of a particle is recorded, this particle goes in a certain direction and not in another, which it might also have followed. According to the second view, whenever indeterminacy is involved, the world multiplies and all the paths that the particle can follow are followed, each, however, in a different world.

The idea of Bostrom is as follows. Suppose we can (one day) prove that the appearance of observers in the physical universe is something infinitely unlikely, given the known laws of nature and the initial conditions of our universe. We, then, should probably not exist. If we exist, then the “many-worlds version” is probably true, where even the most unlikely outcomes occur. For the Bayes’ theorem, in fact, if something E has little initial probability (in our case: that observers appear), but it could happen with much greater probability if a certain hypothesis H was true (in our case: the “many-worlds version”), then, if this E occurs, it is likely that this hypothesis H is also true.

Before introducing the SSA, Bostrom had similarly argued discursively in favor of the theory that ours is one of many other universes: this should make the existence more likely, otherwise very unlikely, of our universe (characteristically fine-tuned and marked by the emergence of conscious observers).

The SSA also has the merit of making the appearance of so-called “Boltzmann brains” highly unlikely, if not impossible (Bostrom does not refers to them, but speaks, similarly, in chap. 3, of “freak observers”, e.g. human brains random emitted by black holes as offsping of Hawking radiation). The idea of Bostrom is this: it cannot be excluded that we live in an illusion (like the famous brain in the vat), as observers completely randomly sprung e.g. by the evaporation of black holes and marked by deceptive perceptions. However, within the “reference class” of all possible observers, it is much more likely that we are observers evolved by natural selection from other living organisms, as we seem to be. In fact, in a fine-tuned universe the number of “normal” observers is reasonably much higher than that of “freak observers”. Just as, when there is traffic, it is more likely to be in the slowest lane, because there are more vehicles, so, in the universe, it is more likely to belong to a species that has evolved over millions of years and that can count billions of individuals than to be “intelligent lives” arising by pure chance from the combination of quantum particles during the evaporation of a black hole. Although it cannot be excluded that some “observer” has this bizarre origin, it is very unlikely that “we” belong to this “exclusive club”, so to speak.

Summing up, applying Bostrom’s “anthropic” reasoning and adopting his “mathematics” (which in chap. 10 takes the form of a very Observation Equation), we should conclude that we exist by pure chance within a multiverse of which we observe an extremely limited portion, “our” universe, the only one that we can observe (for an obvious observation selection effect). There would be nothing wonderful or strange about this. The fact that the universe is fine-tuned would in turn be an observation selection effect: if it were not such, there would be no one to witness it and, above all, we would not be able to do.

Problems with Bostrom’s approach

Is that a convincing conclusion? In my opinion, no. One thing, in fact, is to argue that, if there are countless universes, it is likely that, sooner or later, or somewhere, observers will appear; which, if there was only one universe, would be unlikely. Another thing is to argue, on the same basis (that is, “if there are countless universes…”), that it is probable that we have appeared and, conversely, that, if there are us, there are likely to be countless universes.

“We” are not just any observers who have appeared somewhere. We have come here and now. We are also characterized by being conscious, which means something more than “observing” if by observing we mean an action that could be performed by something or someone who might not be “us” (as e.g. an extraterrestrial intelligence). Consciousness is something that we can only experience by being conscious in the first person.

Summing up: according to Bostrom it is the more probable the appearance of a fine-tuned universe that allows the emergence of observers, the more other universes we admit (multiverse hypothesis). The objection (mine and of a certain Roger White, quoted by Bostrom himself in chap. 2) is that this does not apply if the fine-tuned universe is ours, that is, the observers are us.

Apparently this objection seems unjustified. Bostrom himself (again in chap. 2) points out to White (and implicitly to me too) that, if, in general, the appearance of a fine-tuned universe, which allows the emergence of observers, favors the hypothesis of an almost infinite succession of universes (the multiverse) it would be strange that what applies, in general, to the universes containing observers does not apply to this universe (meaning “this” as a rigid reference), that is, to the universe in which we are.

Bostrom states that White does not bring convincing arguments in favor of his thesis (according to which what generally applies to fine-tuned universes would not apply to ours).

But in my opinion there is a convincing argument. Ironically, Bostrom himself offers it to us on a silver platter (he mentions it in chap. 2). This is an argument drawn from the so-called inverse gambler’s fallacy.

Consider the direct fallacy, the most well-known. A gambler is wrong to think that the more he hasn’t been rolling a double 6, the more likely it is that he is going to roll a double 6 next time.

The inverse fallacy is: if a double 6 has now come out, that means (the gambler mistakenly believes) that there have been many rolls before in which this result has not come out.

But it is easy to understand that this is not necessary at all, because this series of previous rolls would not make the double 6 outcome any more likely.

Similarly – I maintain – the fact that our universe contains observers and is fine-tuned does not entail that there have been many other universes before.

Of course, if you roll two dice many times, the probability that sooner or later a double 6 comes out increases; not this double 6, but only a double 6. In fact, if we do not want to fall into the inverse gambler’s fallacy, we must recognize that, if a double 6 comes out now, this does not increase the likelihood that the dice have been rolled many times before rather than a few times or none.

Thus, if the “many-worlds version” of quantum mechanics were true (which Bostrom believes he can support on the basis of the SSA, provided that certain experimental conditions are given), the probability that sooner or later observers would appear, certainly, would increase.

But the fact is that these observers do not appear sooner or later from our point of view or from the point of view of other observers who can record (observe!) the event. These observers are us now.

If, therefore, we do not want to fall into the inverse gambler’s fallacy, we must grant the following: our (albeit very unlikely in itself) presence makes neither a multiverse more likely than a simple limited universe (like this we observe) nor the “many-worlds version” of quantum mechanics more likely than the “singole-history version”. In sum our presence not make that Nature has rolled countless times the dice more likely than a few or a single time.

In short, the fact that the observers we are talking about are ourselves, now, this short circuit, makes a huge and decisive difference.

So why does the SSA work with traffic and not quantum mechanics? Because I, who already exist and am aware that I exist, can certainly predict that, if I ever get stuck in traffic, it will be more likely that I find myself in the slowest lane rather than the fastest one. But how could the “lane”, whose probability should be calculated, be my own future existence as a conscious observer? There is no “place” where I can calculate the probability that I might be born, because “I myself”, in that place, would not be there yet.

Conversely, if and when there is me, there is me now, in a present (whose probability is equal to 1), which is not just any time when “someone” becomes conscious sooner or later.

It is only the moment whenever any observer emerges to suggest, provided that the emergence of an observer is rare and improbable, that Nature must have made many “vain attempts” to bring it out first. But the present moment, “my” moment, the moment when there is me, the moment only when consciousness emerges properly (a consciousness experienced at the first person) does not require at all to be preceded or joined by failed attempts (by other universes in a multiverse or by many words in the “many-words version” of quantum mechanics), unless you want to fall into the inverse gambler’s fallacy.

It is as if Bostrom calculated in abstract the probability that observers emerge in the universe, for example in the form of Homo sapiens. And this he did as if he were an alien or a computer unconscious and out of the picture. Then he noticed: “What a surprise, we are these observers and we are now!”. So what applied to Homo sapiens applies to us!

But here lies the “bias”. This is not an innocent passage, because there is a difference between

- saying that by rolling pairs of dice increases the probability of a double 6 (the appearance of intelligent life in the universe), which is certainly correct, and

- saying that the fact that there is now a double 6 (we are aware that we exist here) supports the fact that a lot of pairs of dice have been rolled, which is not at all correct.

In short, unless you want to fall into the inverse gambler’s fallacy, since at each roll a double 6 can come out with probability 1/36, when we record a double 6 it could be the only roll made. Of course, there may have been other rolls before, but not “so that” this double 6 came out (or so that it was more likely, here and now, a double 6). Indeed the result I am witnessing here and now is not made any more likely even by a million previous rolls (direct fallacy of a gambler, who bets on numbers that have not come out for some time).

The truth is that a roll made “here and now” makes this roll mysteriously different, whatever arguments Bostrom. In fact, Bostrom is right: the more you roll two dice, the more, in general, it is likely to come out a double 6 (like any other pair of numbers between 1 and 6). But not now! Now the probability is always damn 1/36 (regardless of the number of previous casts).

Similarly, the fact that intelligent life is given here and now in this universe does not tell us damn if there have been other universes before this or not. If the argument drawn from the inverse gamblerìs fallacy is valid, Bostrom is wrong to consider the probability of multiverse high.

The final refinement of the SSA (in chap. 10) in terms of the SSSA (Strong Self-Sampling Assumption) does not change anything and underlies the same bias. Turning “observers” into ” observer-moments” enhances the performance of the SSA, avoiding potential arguments against it, but the problem remains. How can we move from these “observer-moments “, described in third person, to first-person experience (i.e. your or my experience) of these moments? What is true for these moments described in the third person, no longer applies if we live them (estimates of the probability of the conditions that would have made our conscious existence possible or probable lose their value).

Another approach

How to explain, then, our existence as conscious observers, if Bostrom’s reasoning falls into this fallacy?

Let us also admit that the structure of the universe doesn’t favor the argument of intelligent design. An intelligent creator could have created man (a consciousness) in times and spaces much more limited than real, appropriately manipulating energy and matter (although in this way final and formal causes would have been exposed, as when you distinguish an artifact from a natural product). Also the creator could have made a even nicer universe than it is. The breadth of universe spacetime and the clear signs of imperfection that the universe contains suggest that everything happened randomly. Well, let’s say that’s what happened.

Now, if the hypothesis of intelligent design must be rejected and if I am right to find the hypothesis of the multiverse (which Bostrom argues probable, but which to me seems a flagrant violation of Ockham’s razor and an useless hypothesis, as the deceptive appearance of its usefulness is a mere effect of the inverse gambler’s fallacy) how to explain the origin of consciousness (that is, identically, of an observed universe)?

Consciousness seems to arise quite randomly (without anyone having designed it). Its emergence is only made a little more likely by the enormous dimensions of our universe (more precisely, as Barrow and Tipler argue in The Anthropic Cosmological Principle, Oxford, Oxford University Press, 1986: if our universe were not so big and old, intelligent life would in all likelihood be simply impossible). Yet we can certainly imagine countless universes of all possible dimensions in which consciousness never arose. The fine-tuning was therefore an incredible stroke of luck (the analogue of the double 6 above)?

If we eliminate the explanation of the multiverse and also of an intelligent design, what remains to think?

My hypothesis is that the fine-tuning of our universe was not a stroke of luck at all, but depends on the fact that, for a universe to exist, someone must be aware of it. My hypothesis is that a universe, like a quantum particle, in order to exist, must be simply observed. Otherwise it can exist at most only in a unfocused and contradictory way.

As seen in this perspective, the indexical (relative to the observer) aspect of what is observed is relevant. Bostrom also gives importance to this aspect. For example, in the case of traffic, it is because I am slower than others that I can infer that I am in the lane of more vehicles. However, this indexical aspect is treated by Bostrom in an overtly physicalistic way (as he argues in chap. 8). The information we get from our particular perspective is considered valuable, but is only used to enrich our objective knowledge with further information, as in the example of Bostrom: the fact that I have blue eyes (indexical) informs me of the fact that there are people with blue eyes (not indexical). In other words, the information we obtain because we exist in the first person is always translated as information that can be obtained from third parties.

My hypothesis is different: what is calculated (through the SSA) as probably real (for example the multiverse) when we consider observers as third persons must be considered as only possible if we start from the first person experience (here and now): it is not necessary to suppose countless “real” worlds and universes before or beside us to account for the high improbability of our existence; it’s enough to recognize that only one of all the countless possible universes is the real one, the one in which there are we who can observe it and make it, therefore, real.

From this point of view the multiverse could be understood simply as the set of all possible universes, but rendered unreal by the fact that no one is conscious of it.

Similarly, all rolls of two dice (approx. 35 rolls) that give outcome other than the double 6, to which a gambler attends, can be “retrieved” not as material “antecedents” of the double 6, but as spectral “virtual” companions of it: all that could have happened but did not happen.

A final word on this. Also in chapter 2 Bostrom indirectly denies the relevance of the example of double 6 (and, therefore, of the inverse gambler’s fallacy) to the case of the observable universe. He claims that the release of a double 6 has nothing to do with observation selection effects. “As pointed out by three authors […] there is no observation selection effect in his example—an essential ingredient in the purported anthropic explanation of fine-tuning”. It would have something to do with these observation selection effects if you imagined that “the gambler has to wait outside the room until a double 6 is rolled”. So watching a double 6 would be the effect of an observational selection (the gambler could watch “only” at double 6, by convention).

But the opposite is true! If the gambler had to wait outside the room, he would also exist whenever no double 6 is rolled in the room. He would exist and be aware that he exists. If he then had to wait hours and hours before being called in, he would also have good reasons to think that many other pairs of numbers came out before the double 6.

What is wrong in this analogy? Let’s consider: there is a consciousness, that of the gambler, waiting to watch a double 6. What is analogous to this situation? “There is a consciousness waiting to see if in this or that universe appears a… conscious being!” But it is clear that, if the analogy between the roll of the dice and the appearance of observers is to work, the double 6 must directly represent the appearance of observers (or consciousness), not the appearance of observers… of observers!.

My hypothesis, that this universe exists simply because it is the only one of which one is aware (and not as one among countless others, equally “existing”, but of which no one is aware), can also be reached by another way, in which the SSA returns to play a role.

A merit of the SSA consists in the fact that, as Bostrom shows (in chap. 5), it allows to dismantle the claim of Boltzmann, followed in this by many others, to justify the time’s arrow of “our” universe. According to Boltzmann, the irreversible increase of entropy that distinguishes our universe, breaking its symmetry with respect to time, was due to the fact that in a very large universe it would not be impossible to observe local fluctuations in the values of entropy, so in some regions (like the one we are in) entropy could be randomly very low and therefore destined to grow (as we actually observe it happening). This would be compatible, therefore, with the image of a universe globally symmetrical with respect to time.

Bostrom has a good game to prove that, if the SSA is valid, these fluctuations are certainly possible and “we” could certainly find ourselves in a region marked by an increase in entropy and, therefore, by a time’s arrow (unique condition compatible with the appearance and evolution of life). However, this region, probably, should be much smaller than our universe which is about 40 thousand light years wide and appears globally marked by irreversible increase in entropy. In fact, the fluctuations Boltzmann talks about should be both small and large. But the small ones should be much more frequent and numerous. Therefore, for the SSA, conscious observers should appear much more frequently and in larger number in much smaller regions of the universe than we do. For the SSA we should therefore inhabit a much smaller universe. Since this is not the case, Boltzmann’s explanation of why we experience an irreversible increase in entropy is probably wrong.

This criticism of Boltzmann’s argument remains valid even if the SSA, as I maintain, cannot be used to argue (as Bostrom does) that our universe appeared randomly within a much larger multiverse. In fact, used against Boltzmann’s argument, the SSA does not directly apply to the emergence of consciousness here and now (which, as I have already argued, unless you want to fall into the inverse gambler’s fallacy, is an event that does not allow you to estimate the probability of the multiverse), but to the problem of time’s arrow, determined by the direction of the increase in entropy (which is an objective datum, not related to “here and now”). The conclusion of Bostrom is, therefore, correct: the fluctuations conjectured by Boltzmann do not explain why a time’s arrow of time characterizes a universe as large as ours.

My explanation of this mystery goes in the same direction as my explanation of the origin of our observable universe: as there cannot exist but a universe of which one is conscious, so there cannot exist but a universe admitting living observers, that is a universe marked by an irreversible increase of entropy and a consequent time’s arrow (the unique condition to which living beings can exist). In short, it is the same consciousness to decide which universe (not only appears to us, for a “trivial” observation selection effect, but also simply) exists, both a) regarding its being, generically, fine-tuned, and b) regarding its being, specifically, characterized by irreversible increase in entropy.

And here I mention, finally, another limit of Bostrom’s approach. Bostrom thinks as if space and time could be real (existing) in the absence of observers. Expanding at will space and time Bostrom can then imagine multiverses, many worlds and other possible conditions capable of making the appearance of conscious observers less unlikely. Although in chap. 1 he refers to Kant as a precursor of the need to take into account observation selection effects, he seems to ignore the fundamental Kant’s lesson: the first (distorting) effect due to observation could be the belief that the universe is traversed by a system of spacetime axes, but a spacetime system may not exist at all in the absence of observers, because it is part of the perceptive system.

So, if, following Leibniz, Kant and many others, we suppose that space and time are “subjective”, that is, they depend on the fact that there are observers (they are in short only a way of observing reality), the “multiverse” that Bostrom posits as a plausible condition of the appearance of conscious observers can be conceived only as something “virtual” or purely “conceptual”, as the imaginary (“spectral”) set of rolls other than the double 6 that we ourselves are.

It must be said that Bostrom, beyond his specific theses, has the great merit of analytically discussing, using suitable mathematical tools, the different hypotheses formulated by him and by many other authors about anthropic reasoning, providing the reader with a vast and fascinating panorama. He also motivates a reader who does not agree with his thesis to argue alternative points of view with the same rigour. And that’s exactly what I tried to do.

Come intendere il cosiddetto “principio antropico”?

Il libro di Nick Bostrom, Anthropic bias: Observation Selection Effects in Science and Philosophy, London, Routledge 2002 (ed. on line 2020), è senz’altro di grande interesse, anche per chi si interroga su origine e natura della coscienza, in quanto fa il punto con rigore “matematico”, per così dire, sulla vexata quaestio del cosiddetto “principio antropico”.

Secondo questo principio il nostro universo sarebbe caratterizzato da certi parametri (in termini di condizioni iniziali e/o di leggi fisiche) perché questi sarebbero gli unici compatibili con la “nostra” stessa esistenza (in questo senso sarebbe un universo “fine-tuned”, finemente sintonizzato).

Bostrom sgombra il campo innanzitutto (nel cap. 1) da un equivoco: per “nostra” stessa esistenza si deve intendere non tanto l’esistenza dell’Homo sapiens, come specie vivente, anche se originariamente (nel 1974) Brandon Carter aveva denominato questo principio equivocamente, appunto, “antropico”, quanto l’esistenza di “osservatori” dell’universo stesso (o anche, come anche talora Bostrom si esprime, l’esistenza, sulla Terra o altrove, di “vita intelligente”, in generale, cfr. sempre cap. 1 e passim). In sostanza si tratta della questione delle ragioni per le quali il nostro universo sarebbe non solo esistente, ma anche “osservabile”.

Anche se, come discuterò più oltre, la nozione di “osservatore” non è del tutto sovrapponibile a quella di “coscienza”, in tutti i possibili significati delle due nozioni, la questione dell’origine di un universo osservabile e quella dell’origine della coscienza sono tra loro palesemente legate.

Riguardo all’origine del nostro universo, in quanto universo osservabile, le macro-teorie che Bostrom discute si possono ricondurre a due: o a) il nostro universo sarebbe osservabile (ospiterebbe vita intelligente e cosciente) per un intelligent design (cioè sulla base di un progetto, verosimilmente divino, che avesse fin dall’origine per fine la nostra apparizione) oppure b) esso sarebbe tale per caso.

Bostrom non prende sul serio la prima ipotesi: l’intelligent design viene respinto, tra l’altro, con l’argomento che, per sostenerlo, bisognerebbe dimostrare che il nostro sarebbe il migliore dei mondi possibili, tratto che Bostrom giudica evidentemente poco plausibile. Sottinteso in diverse parti del volume, questo argomento viene formalizzato, sia pure in via ipotetica, ricorrendo al teorema di Bayes, nel cap. 11 con queste parole:

If our universe is not of the sort that one might have suspected a creator to create if he created only one universe (if our universe is not the “nicest” possible one in any sense, for example), then the conditional probability […] on any creator-hypothesis involving the creation of only one universe might well be so slim etc.

Bostrom considera più attendibile (probabilmente la sola degna di una trattazione scientifica) la seconda ipotesi, cioè che l’universo sia sorto per caso.

E come mai, allora, è così fine-tuned come se avesse per fine la nostra esistenza o, meglio, l’esistenza di osservatori?

La tesi di Bostrom è sostanzialmente la seguente: il nostro universo appare “miracolosamente” fine-tuned per un (banale) observation selection effect: non potremmo certamente osservare un universo in cui non vi fossero osservatori! In generale, per Bostrom, in campo scientifico bisogna tener conto di questi observation selection effects (questa sarebbe la grande lezione del principio antropico, reinterpretato come “pregiudizio antropico” o, forse meglio intendere, “distorsione antropica”): le cose (leggi di natura, leggi dell’evoluzione, condizioni iniziali ecc.) ci appaiono in un certo modo piuttosto che in altro anche sulla base del fatto che possano essere osservate da noi. Leggi di natura o condizioni iniziali non compatibili con la nascita della vita intelligente (e cosciente) sulla Terra non possono ovviamente venire “scoperte”. Ciò non esclude (ma, secondo Bostrom, piuttosto suggerisce) che vi siano infinitamente più cose “in cielo e in terra”, che, “per costruzione”, non conosceremo mai, quelle, appunto, che non possiamo osservare.

In particolare, accettata questa prospettiva ateologica e ateleologica, che dà rilevanza al puro caso, le ipotesi sono di nuovo due: o 1) il nostro universo è il solo universo esistente oppure 2) esso è soltanto uno di innumerevoli o infiniti altri “universi”, il solo appunto osservabile (o uno dei pochi o molti osservabili), ragione per la quale noi appunto osserviamo questo universo e non altri.

Bostrom sembra propendere decisamente per questa seconda ipotesi.

L’argomento è sostanzialmente questo: sarebbe davvero strano che sia sorto casualmente un solo universo e che proprio questo sia fine-tuned e ospiti anche vita intelligente, soprattutto se supponiamo che questa, in se stessa altamente improbabile, sarebbe stata impossibile in un universo anche solo poco diverso dal nostro. Molto più verosimile, dunque, l’ipotesi del multiverso.

Questa tesi non è argomentata soltanto discorsivamente, ma ricorrendo a strumenti logici e matematici, essenzialmente al teorema di Bayes e a suoi derivati. Essa viene sostenuta, in particolare, a partire da un’assunzione centrale nel libro, la Self-Sampling Assumption (SSA), che, nella sua prima formva (introdotta alla fine del cap. 3 e successivamente migliorata e corretta), suona come segue:

One should reason as if one were a random sample from the set of all observers in one’s reference class

Cioè: “si dovrebbe ragionare come se si fosse un campione tratto casualmente dall’insieme di tutti gli osservatori appartenenti alla propria classe di riferimento”.

Per capire che cosa intende Bostrom con questa assunzione e, in particolare, per comprendere il suo rilievo “matematico” si può evocare il suo impiego nell’analisi del traffico, come fa Bostrom stesso (nel cap. 4). Se finisci imbottigliato in una coda dove una corsia è più lenta e una più veloce il fatto di trovarti più probabilmente in quella più lenta non è dovuta a una dannata “legge di Murphy”, come potresti pensare, ma alla banale circostanza che la corsia più lenta è anche quella dove si trova il maggior numero dei veicoli, dunque probabilmente anche il tuo! In questo esempio tu sei un “campione” (sample) tratto dall’insieme di tutti gli automobilisti che si trovano nel traffico (classe di riferimento). Appare più probabile che tu ti trovi nella corsia più lenta che in quella più veloce semplicemente perché in questa vi sono più veicoli, dunque più automobilisti.

Come si applica quest’assunzione al “principio antropico”? Bostrom (nel cap. 4) fa una serie di esperimenti mentali per illustrarlo, immaginando altrettanti “universi giocattolo”; quindi (nel cap. 5 e seguenti) applica quest’assunzione a diverse questioni scientifiche aperte, variamente collegate o collegabili col principio antropico, come l’origine di questo universo, la spiegazione di Boltzmann della freccia del tempo, l’evoluzione della vita intelligente sulla Terra ed eventualmente in altri pianeti ecc.

Ecco, ad esempio, come si applica la SSA nell’esperimento mentale (introdotto nel cap. 4 e ripreso nel cap. 10) dell’incubatore. Immaginiamo di lanciare una moneta: se esce croce viene creata una stanza contenente un uomo con la barba nera; se esce testa vengono create due stanze: una contenente un uomo con la barba nera e un’altra contenente un uomo con la barba bianca. In assenza di altre informazioni, se noi fossimo uno di questi uomini appena “creati” e conoscessimo il modo in cui questa creazione è avvenuta, considereremmo egualmente probabile che sia uscita croce e che sia uscita testa. Tuttavia, se si accendesse la luce e scoprissimo di avere la barba nera, secondo Bostrom, in base alla SSA (Self-Sampling Assumption), dovremmo ritenere che sia uscita croce con due probabilità contro una. Il ragionamento, espresso senza ricorrere alla matematica, potrebbe suonare così: in assenza di altre informazioni le probabilità di testa e di croce si equivalgono, ma ciò non è più vero quando scopro di avere la barba nera: infatti, se fosse uscita testa, avrei potuto avere la barba anche bianca: dunque è più probabile che sia uscita croce. In effetti quello che si applica è il teorema di Bayes: le probabilità iniziali di un determinato evento E possano aumentare o diminuire (trasformandosi così in probabilità finali o condizionali), qualora si verifichi o non si verifichi un determinato altro evento F o nel caso che sia vera o falsa una determinata teoria H. Nel caso dell’incubatore il fatto di sapere di avere la barba nera (evento nuovo) mi fornisce un’informazione supplementare (a favore di una teoria piuttosto che di un’altra) che mi fa modificare la mia stima delle probabilità iniziali.

Come si applica questa SSA a questioni scientifiche nelle quali è coinvolto il principio antropico?

Ad esempio Bostrom usa questa SSA per sostenere (cap. 5) che sia teoricamente possibile testare sperimentalmente quale tra due classiche interpretazioni della meccanica quantistica sia più probabilmente vera, tra quella secondo la quale è data “una sola storia” e quella “a molti mondi”. Secondo la prima interpretazione ogni volta che si registra il collasso della funzione d’onda di una particella, essa va in una certa direzione e non in un’altra, che essa pure avrebbe potuto seguire (dato il principio di indeterminazione). Secondo la seconda interpretazione ogniqualvolta è coinvolto un momento di indeterminazione il mondo si sdoppia, anzi si moltiplica e tutti i percorsi che la particella può seguire sono seguiti, ciascuno, però, in un mondo diverso.

L’idea di Bostrom è la seguente. Supponiamo che si possa un giorno dimostrare che l’apparizione di osservatori nell’universo fisico sia qualcosa di infinitamente improbabile date le leggi di natura note e le condizioni iniziali dell’universo. “Noi”, dunque, non dovremmo probabilmente esistere. Se esistiamo ciò dipende allora dal fatto che è probabilmente vera l’interpretazione a molti mondi, in cui anche gli esiti più improbabili si verificano. Per il teorema di Bayes, infatti, se qualcosa E ha probabilità a priori scarse (nel nostro caso: che appaiano osservatori), ma si potrebbe verificare con molta maggiore probabilità se fosse vera una certa ipotesi H (nel nostro caso: l’interpretazione “a molti mondi”), allora, se questo qualcosa E si verifica, è probabile che anche quest’ipotesi H sia vera.

In precedenza, prima di introdurre la SSA, Bostrom, come detto, aveva analogamente argomentato discorsivamente a favore della teoria secondo la quale il nostro sarebbe uno di molti altri universi: ciò dovrebbe rendere più probabile l’esistenza, altrimenti assai improbabile, del nostro universo (caratteristicamente fine-tuned e contraddistinto dall’emergere di osservatori coscienti).

La SSA ha anche il pregio di rendere altamente improbabile, anche se non impossibile, l’apparizione dei cosiddetti “cervelli di Boltzmann” (Bostrom non li evoca, ma parla, analogamente, nel cap. 3, di “freak observers”, osservatori strani scaturiti “random” magari dall’evaporazione di buchi neri). L’idea di Bostrom è questa: non si può escludere che noi viviamo in un’illusione (come il celebre cervello nella vasca), come osservatori scaturiti del tutto casualmente ad es. dall’evaporazione di buchi neri e contraddistinti da percezioni ingannevoli. Tuttavia, all’interno della “classe di riferimento” costituita da tutti gli osservatori possibili, è assai più probabile che le cose stiano come appaiono, cioè che siamo osservatori evolutisi per selezione naturale da altri organismi viventi. Infatti, in un universo fine-tuned il numero degli osservatori “normali” è ragionevolmente molto superiore a quello degli “osservatori strani”. Proprio come, quando c’è traffico, è più probabile trovarsi nella corsia più lenta, perché vi si trovano più veicoli, così, nell’universo, è più probabile appartenere a una specie evolutasi in milioni di anni che può contare miliardi di individui che all’insieme ristretto di “intelligenze” scaturite per puro caso dalla combinazione di particelle quantistiche dall’evaporazione di un buco nero. Anche se non si può escludere che qualche “osservatore” abbia questa bizzarra origine, è assai poco probabile che “noi” apparteniamo a questo “club esclusivo”, per così dire.

Tirando le somme, applicando l’approccio “antropico” di Bostrom e adottando la sua “matematica” (che nel cap. 10 assume la forma di una vera e propria equazione osservazionale), si dovrebbe concludere che noi esistiamo per puro caso all’interno di un multiverso di cui osserviamo una porzione estremamente limitata, il “nostro” universo, il solo che possiamo appunto osservare (per un evidente observation selection effect). Non ci sarebbe nulla di meraviglioso o di strano in tutto questo. Il fatto che l’universo sia fine-tuned sarebbe a sua volta un observation selection effect: se non fosse tale, non ci sarebbe nessuno a testimoniarlo e, soprattutto, non ci saremmo noi a poterlo fare.

Limiti dell’approccio di Bostrom

Si tratta di una conclusione convincente? Secondo me, no. Una cosa, infatti, è sostenere che, se ci sono innumerevoli universi, è probabile che, prima o poi, o da qualche parte, si verifichi qualcosa che, se esistesse un universo solo, sarebbe di per sé improbabile: cioè che appaiano osservatori. Altra cosa è sostenere, sulle stesse basi (cioè, se ci sono innumerevoli universi), che sia probabile e, quindi, spiegabile il fatto che siamo apparsi noi (e, inversamente, che, se ci siamo noi, sia probabile che ci siano innumerevoli universi).

“Noi” non siamo osservatori qualsiasi apparsi prima o poi da qualche parte. Siamo osservatori apparsi qui e ora. Inoltre siamo contraddistinti dall’essere coscienti, cosa che significa qualcosa di più che “osservare” se per osservare intendiamo un’azione che potrebbe venire compiuta da qualcosa o da qualcuno che potrebbe tranquillamente non essere “noi” (come p.e. un’intelligenza extraterrestre) e pensiamo, viceversa, la coscienza come qualcosa che possiamo sperimentare solo essendo coscienti in prima persona.

Riassumendo: Bostrom asserisce che è tanto più probabile l’apparizione di un universo fine-tuned che permetta l’emergere di osservatori, quanti più altri universi precedenti (e successivi) ammettiamo (ipotesi del multiverso). L’obiezione (mia e di un certo Roger White, citato da Bostrom stesso nel cap. 2) è che ciò non vale se l’universo fine-tuned è il nostro, cioè gli osservatori in questione siamo noi.

Apparentemente questa obiezione non sembra sensata. Bostrom stesso (sempre nel cap. 2) fa notare a White (e implicitamente anche a me) che, se, in generale, l’apparizione di un universo fine-tuned, che permette l’emergere di osservatori, favorisce l’ipotesi di una successione pressoché infinita di universi (il multiverso), sarebbe strano che quello che vale, in generale, per gli universi contenenti osservatori non valga proprio per questo nostro universo (intendendo “questo” come riferimento rigido), cioè per l’universo in cui ci siamo noi.

Bostrom afferma che White non porta argomenti convincenti a favore della sua tesi (secondo la quale quello che vale in generale per universi fine-tuned non varrebbe per il nostro).

Ma l’argomento convincente secondo me c’è. Per ironia della sorte ce lo offre lo stesso Bostrom su un piatto d’argento (lo cita sempre nel cap. 2). Si tratta di un argomento tratto dalla cosiddetta fallacia inversa del giocatore d’azzardo.

Consideriamo la fallacia diretta, quella più nota. Un giocatore d’azzardo sbaglia a pensare che, quanto più numerosi sono i lanci di due dadi dai quali non esce un doppio 6, tanto più probabile sarà che al prossimo lancio esca un doppio 6. Di fatto a ogni lancio la probabilità è sempre di 1/36.

La fallacia inversa è: se ora è uscito un doppio 6, ciò significa (crede erroneamente il giocatore d’azzardo) che ci sono stati prima molti lanci nei quali questo risultato non è uscito.

Ma è facile intuire che questo non è affatto necessario, perché questa serie di lanci antecedenti non renderebbe affatto più probabile l’uscita del doppio 6.

Analogamente – io sostengo – il fatto che questo nostro universo contenga osservatori e sia fine-tuned, non comporta affatto che vi siano stati prima altri numerosi universi differenti.

Certo, se lancio molte volte due dadi, la probabilità che prima o poi un doppio 6 esca aumenta; non però questo doppio 6, ma solo un doppio 6. Infatti, se non vogliamo cadere nell’inverso della fallacia del giocatore d’azzardo, dobbiamo riconoscere che, se adesso esce un doppio 6, ciò non aumenta affatto la probabilità che siano stati lanciati molte volte i dadi in precedenza piuttosto che poche volte o nessuna.

Così, se fosse vera l’interpretazione della meccanica quantistica “a molti mondi” (che Bostrom crede di poter suffragare sulla base della SSA, a condizione che certe condizioni sperimentali siano soddisfatte), la probabilità che prima o poi appaiano osservatori, certo, crescerebbe.

Ma il fatto è che questi osservatori non appaiono prima o poi agli occhi magari nostri o di altri osservatori che possano registrare l’evento. Questi osservatori siamo noi adesso.

Se non vogliamo, dunque, cadere nella fallacia inversa del giocatore d’azzardo, dobbiamo ammettere quanto segue: la nostra (pur assai improbabile, in se stessa) presenza non rende più probabile né un multiverso rispetto a un semplice universo limitato come quello che osserviamo (non rende più probabile il fatto che la Natura abbia lanciato innumerevoli volte i dadi invece che poche o una sola), né l’interpretazione “a molti mondi” della meccanica quantistica rispetto a quella “a una storia sola”.

Insomma, il fatto che gli osservatori di cui parliamo siamo noi stessi, ora, questo cortocircuito, fa un’enorme e decisiva differenza.

Perché, allora, la SSA funziona con il traffico e non con la meccanica quantistica? Perché io, che già esisto e sono cosciente di esistere, posso senz’altro prevedere che, se mai sarò imbottigliato nel traffico, sarà sempre più probabile che mi trovi nella corsia più lenta (e più affollata) piuttosto che in quella più veloce. Ma come potrebbe la “corsia”, di cui calcolare la probabilità, essere la mia stessa esistenza futura di osservatore cosciente? Non c’è un “luogo” dal quale io possa calcolare la probabilità che io possa nascere, perché “io stesso”, in quel luogo, non ci sarei ancora.

Viceversa, se e quando ci sono, ci sono adesso, in un presente (la cui probabilità è pari a 1), che non è un momento qualsiasi in cui “qualcuno” diviene cosciente prima o poi.

È soltanto il momento qualsiasi in cui emerge un osservatore qualsiasi a suggerire, posto che l’emergere di un osservatore sia cosa rara e improbabile, che prima la Natura deve avere fatto molti tentativi vani di farlo emergere. Ma il momento attuale, il “mio” momento, il momento in cui “io” ci sono, il momento in cui emerge la coscienza propriamente detta (quella sperimentata in prima persona), se non si vuole cadere nella fallacia inversa del giocatore d’azzardo, non richiede affatto di essere preceduto o affiancato da tentativi falliti (da altri universi in un multiverso o da “molti mondi” nella citata interpretazione della meccanica quantistica).

È come se Bostrom calcolasse in astratto la probabilità che emergano osservatori nell’universo, ad esempio nella forma degli Homo sapiens. E questo lo facesse come se egli fosse un alieno o un calcolatore privo di coscienza e fuori dai giochi. Poi notasse: “Ohibò, ma noi siamo questi osservatori e lo siamo adesso!”. Quindi – ragiona – quello che si applicava all’Homo sapiens si applica proprio a noi!

Ma proprio qui si nasconde il sofisma (il “bias” per fare il verso a Bostrom). Questo non è un passaggio innocente, esattamente come è diverso

a) dire che a furia di tirare coppie di dadi aumenta la probabilità di un doppio 6 (l’apparizione di vita intelligente nell’universo), cosa senz’altro corretta, e

b) dire che il fatto che ora sia uscito un doppio 6 (noi siamo qui coscienti di esistere) militi a favore del fatto che siano state tirate un sacco di coppie di dadi, cosa nient’affatto corretta.

Insomma, se non si vuole cadere nella fallacia inversa del giocatore d’azzardo, dal momento che a ogni lancio un doppio 6 può uscire con probabilità 1/36, quando registriamo un doppio 6 potrebbe benissimo trattarsi del solo e unico lancio effettuato. Certo, potrebbero essercene stati anche altri prima, ma non “affinché” uscisse questo doppio 6 (o affinché fosse più probabile, qui e ora, un doppio 6), visto che il risultato a cui qui e ora assisto non è reso affatto più probabile neppure da un milione di lanci precedenti (fallacia diretta del giocatore d’azzardo, che scommette sui numeri che non sono usciti da un certo tempo).

Il fatto che si tratti di un lancio fatto “qui e ora” rende questo lancio misteriosamente diverso, checché ne argomenti Bostrom. Infatti, ha ragione Bostrom: quanti più lanci si fanno, tanto più, in generale, è probabile che esca un doppio 6 (come qualsiasi altra coppia di numeri compresi tra 1 e 6). Ma non adesso! Adesso la probabilità è sempre dannatamente 1/36 (indipendentemente dal numero dei lanci precedenti).

Analogamente il fatto che qui e ora si dia vita intelligente in questo universo non ci dice dannatamente se prima di questo vi siano stati altri universi oppure no. Se vale l’argomento tratto dalla fallacia inversa del giocatore d’azzardo, Bostrom si sbaglia a considerare alta la probabilità del multiverso.

Il perfezionamento finale della SSA (nel cap. 10) nei termini della SSSA (Strong Self-Sampling Assumption) non cambia la sostanza e sottende lo stesso sofisma. Il fatto di trasformare gli “osservatori” in “momenti di osservazione” migliora le prestazioni della SSA, evitando potenziali argomenti a sfavore, ma rimane il problema di passare da questi “momenti di osservazione”, descritti in terza persona, all’esperienza in prima persona, mia o tua, di questi momenti. Ciò che vale per questi momenti descritti in terza persona, non vale più se siamo noi a viverli (saltano tutte le stime relative alla probabilità di questa o quell’ipotesi sulle condizioni al contorno che avrebbero reso possibile o probabile la nostra esistenza cosciente).

Un altro approccio: la funzione ontopoietica dell’osservatore

Come spiegare, allora, la nostra esistenza di osservatori coscienti, se il ragionamento di Bostrom cade in questa fallacia e se non possiamo evocare il tradizionale argomento di un intelligent design?

Ammettiamo pure (senza concederlo) che la struttura dell’universo sfavorisca l’argomento dell’intelligent design, concepito grossolanamente. Un creatore intelligente, infatti, avrebbe potuto creare l’uomo (una coscienza) in tempi e spazi molto più contenuti, manipolando opportunamente energia e materia (anche se in questo modo le cause finali e formali sarebbero apparse fin troppo scoperte, come quando si distingue un artefatto da un prodotto naturale). Inoltre il creatore avrebbe potuto fare le cose ancora migliori (“nicest”) di come sono. Le dimensioni spaziotemporali dell’universo e i chiari segni di imperfezione che esso contiene suggeriscono invece che il tutto sia avvenuto casualmente. Bene, ammettiamo che sia andata così.

Ora, se l’ipotesi dell’intelligent design va respinta e se ho ragione io a trovare inverosimile anche l’ipotesi del multiverso (che Bostrom sostiene probabile, ma che a me sembra, oltre che una flagrante violazione del rasoio di Ockham, un’ipotesi inutile, in quanto l’ingannevole apparenza della sua utilità è un mero effetto della fallacia inversa del giocatore d’azzardo), come spiegare l’origine della coscienza (cioè, identicamente, di un universo osservabile, anzi, di fatto, osservato)?

La coscienza sembra bensì scaturire del tutto casualmente (senza che nessuno l’abbia progettata, se escludiamo l’ipotesi del design). Essa è resa soltanto un po’ più probabile, nella sua intrinseca improbabilità, dalle dimensioni enormi del nostro universo (più precisamente, come argomentano Barrow e Tipler in The Anthropic Cosmological Principle, Oxford, Oxford University Press, 1986: se il nostro universo non fosse così grande e vecchio, la vita intelligente con ogni probabilità sarebbe semplicemente impossibile). Eppure possiamo senz’altro immaginare innumerevoli universi di tutte le dimensioni possibili in cui essa non sia mai scaturita. Il fine-tuning è stato dunque un incredibile colpo di fortuna (l’analogo del doppio 6 di cui sopra)?

Se eliminiamo la spiegazione che si appella al multiverso e anche quella di un intelligent design grossolanamente inteso, che cosa rimane da pensare?

La mia ipotesi è che il fine-tuning del nostro universo non sia stato affatto un colpo di fortuna, ma dipenda del fatto che, affinché possa esistere un universo, occorre che se ne sia coscienti. La mia ipotesi è che un universo, come una particella quantistica, per esistere in modo non sfocato o contraddittorio, deve essere osservabile, anzi deve essere osservato.

Come si vede in questa prospettiva l’aspetto indexical (relativo all’osservatore) di ciò che si osserva è determinante. Anche Bostrom dà rilevanza a questo aspetto. Ad esempio nel caso del traffico è perché sono più lento di altri che posso inferire che mi trovo nella corsia percorsa da un maggior numero di veicoli. Tuttavia, questo aspetto indexical è trattato da Bostrom in modo dichiaratamente fisicalistico (come egli argomenta nel cap. 8) ossia oggettivistico. Le informazioni che ricaviamo dalla nostra peculiare prospettiva sono considerate bensì preziose, ma vengono utilizzate soltanto per arricchire di ulteriori elementi informativi le nostre conoscenze oggettive, come nell’esempio di Bostrom: il fatto “indexical” che io abbia gli occhi azzurri mi informa del fatto “non indexical” che ci sono persone con occhi azzurri. In altre parole le informazioni che ricaviamo in quanto esistiamo in prima persona vengono sempre tradotte come informazioni che “si” possono ricavare, cioè informazioni ricavabili da terze persone.